Bondy Blog : Vous affirmez que la surveillance de l’espace public est totale, pourriez-vous commencer par faire un état des lieux des systèmes actuellement en place ?

Arthur Messaud, juriste pour la Quadrature du Net : Pour aboutir à cette surveillance généralisée, plusieurs systèmes se combinent. Il y a d’abord les caméras de vidéosurveillance : il y en a près d’un million déployées sur le territoire. Celles-ci sont depuis quelques temps couplées avec des logiciels d’intelligence artificielle qui permettent aux policiers d’analyser les corps et les visages pour détecter des comportements « indésirables ».

Dans ce fichier, 8 millions de visages sont répertoriés

Vous dénoncez aussi le fichage de masse de la population qui sert au développement de la reconnaissance faciale…

Oui exactement ! Depuis 2012, l’État a mis en place deux méga-fichiers : le TAJ [traitement des antécédents judiciaires, NLDR] qui recense 19 millions de personnes. On y trouve les auteurs ou complices de crime, de délit, mais aussi les victimes d’infractions ou les personnes suspectées et non condamnées. Dans ce fichier, 8 millions de visages sont répertoriés. La police a la possibilité de comparer ces visages avec des images de vidéosurveillance, des photos prises sur les réseaux sociaux ou encore lors de contrôles d’identité, pour déterminer précisément l’identité d’une personne ainsi que ses antécédents.

Cette surveillance généralisée de l’espace public, correspond en réalité à une chasse aux pauvres.

Vous dites que l’utilisation massive de la reconnaissance faciale par la police est déjà une réalité depuis 2012 ?

L’outil de reconnaissance faciale pour interroger le TAJ est de plus en plus utilisé par les forces de l’ordre. D’après les chiffres du ministère de l’Intérieur, confirmé par un rapport parlementaire, 498 871 demandes de reconnaissance faciale ont été faites par les services de police en 2021, contre 375 747 en 2019. Ce qui veut dire que cette technologie est utilisée en moyenne 1300 fois par jour ! À ce stade, ce n’est plus une expérimentation.

Réalisé par Sylvain Louvet et Ludovic Gaillard, le documentaire Tous surveillés : 7 milliards de suspects a obtenu le Prix Albert Londres en 2020.

En novembre 2020, vous avez déposé un recours devant le Conseil d’État pour faire interdire la reconnaissance faciale dans le fichier TAJ. Vous vous fondiez sur l’absence de nécessité absolue. Pourquoi le Conseil d’État vient-il de rejeter votre recours ?

C’est le serpent qui se mord la queue. Le Conseil d’État dit qu’au vu du nombre de personnes recensées dans ce fichier, il est impossible pour les policiers de procéder manuellement à une telle comparaison d’images. C’est donc grâce au fichage de masse que le Conseil d’État valide l’usage de la reconnaissance faciale algorithmique. Mais nous, on dit : « Vous avez créé un monstre qui maintenant vous permet de justifier ces dérives contre les libertés publiques ! ». En revanche, ce que nous dit le Conseil d’État, c’est que si, dans la pratique, la police fait n’importe quoi, il faut aller devant la CNIL [Commission nationale informatique et libertés, NDLR]. Ce que nous allons faire pour que la Commission enquête sur ces dérives liberticides.

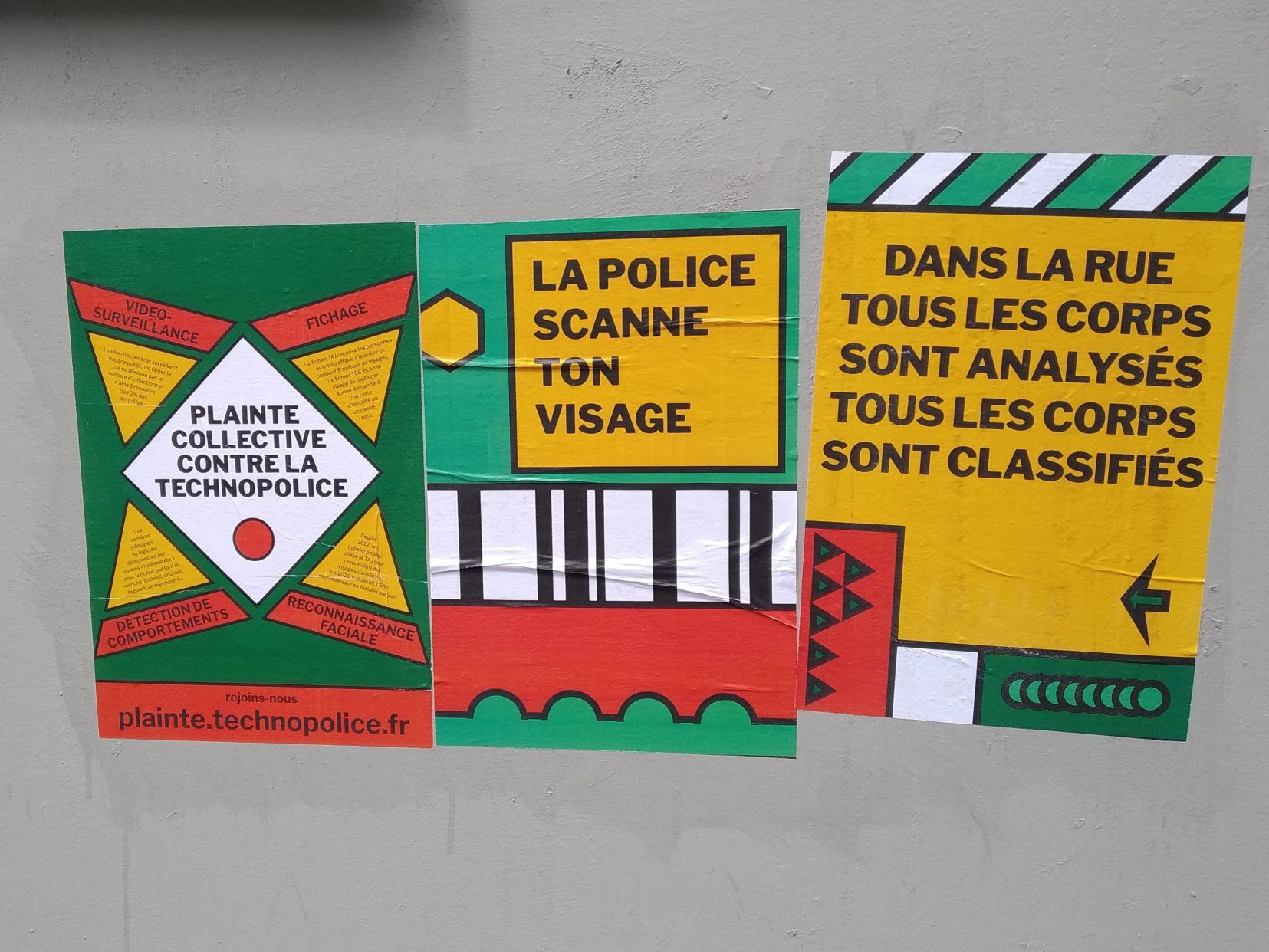

Dans les rues, la campagne pour le recueil de signatures en ligne devrait durer tout l’été.

D’ici l’automne, la Quadrature du Net ambitionne de déposer une plainte collective devant la CNIL. Sur quoi attaquez-vous l’État français et que lui demandez-vous ?

Cette plainte collective devant la CNIL possède plusieurs volets mais on attaque principalement l’absence totale d’encadrement juridique de la reconnaissance faciale utilisée par la police. Aucun juge ne l’autorise, les personnes ne sont pas informées, et aucun contrôle n’est fait à postériori. On sait bien qu’aucun cadre légal ne pourra être mis en place car c’est le propre des outils de surveillance de masse qui ne permettent pas de contrôle au cas par cas. Alors on réclame l’arrêt de l’utilisation de la reconnaissance faciale et la suppression des visages du fichier TAJ. Avec ce type de technologies, c’est l’état de droit qui disparaît.

Contre les caméras, la vidéosurveillance algorithmique), le fichage et la reconnaissance faciale, nous devons être le plus nombreux possible pour déposer ensemble une plainte contre le ministère de l'Intérieur

Rejoignez-nous, parlez-en autour de vous -> https://t.co/9M7yozfSmN— La Quadrature du Net (@laquadrature) June 9, 2022

Comment mobiliser les citoyens sur ces questions de surveillance, un peu abstraites et dont on préférerait ne pas avoir connaissance ?

L’enjeu, c’est avant tout de mettre cette surveillance généralisée dans le débat public. Puisque tout se fait dans l’opacité, qu’aucun scandale n’éclate et qu’aucune loi sur la question n’est mise en discussion. C’est vrai que dans nos imaginaires, la surveillance est invisible. Pour se mobiliser, les gens s’attendent à ce que ça devienne dramatique, qu’il y ait le feu partout ou que Skynet contrôle le monde. Mais dans la réalité, la surveillance de masse est déjà là. Notre campagne d’information et de sensibilisation prend comme prétexte un argument juridique pour illustrer une confrontation bien réelle : celle du gouvernement, de la police et des industriels contre une partie du peuple et contre les libertés publiques. Ce qu’on veut, c’est décourager nos adversaires, et en vrai, ça marche ! Ça a déjà fonctionné contre les GAFAM.

Quand on pense à la surveillance généralisée, on pense à la série Black Mirror ou à la politique mise en place par la Chine, pas nécessairement à la France…

C’est bien ça le problème. Cette science-fiction, qui fait peur, s’est installée sans que l’on puisse en parler et donc sans que l’on puisse lutter contre. Des séries comme Black Mirror, ça donne aux gens les repères d’un horizon lointain. Ils se disent : « Oh ça va on n’est pas dans Black Mirror ». Alors que les choses qui sont censées nous inquiéter comme la surveillance de masse ou l’omniprésence de l’intelligence artificielles sont déjà là. Pareil pour la Chine, c’est l’argument des politiques qui disent : « En France, on a le RGPD [Règlement Général sur la Protection des Données, NDLR], c’est pas la Chine ». Alors qu’en coulisse, le pays fait la course pour se doter des meilleures technologies de surveillance, par peur de devenir le tiers-monde de l’intelligence artificielle.

Le site Technopolis est pensé comme un forum pour organiser la lutte contre les technologies de surveillance policière mises en place dans les villes.

Depuis 3 ans, vous avez lancé l’initiative Technopolice pour recenser les nouvelles technologies policières installées dans les villes. Quelle est l’ampleur de cette surveillance algorithmique ?

La ville est en train de devenir un endroit où depuis une tour de contrôle, des agents décident de ce qui est un comportement acceptable et de ceux qui sont à bannir. Nous avons recensé une cinquantaine de villes en France qui sont en train de déployer des projets de vidéosurveillance algorithmique (VSA). Ces logiciels installés sur les caméras, analysent le flux d’images et sont capables d’alerter les policiers lorsqu’ils détectent des comportements « indésirables ». Ça peut être des jeunes assis sur un banc, des gens qui taguent, qui organisent des maraudes ou d’autres qui resteraient statiques pendant trop longtemps.

Cette surveillance généralisée de l’espace public, correspond à une chasse aux pauvres

Mais ces logiciels sont bien incapables de détecter des attentats, des crimes ou des agressions sexuelles faute de pouvoir entraîner les machines avec des images-type. Ils ne sont pas non plus entraînés pour repérer les délits en col blanc, mais bien pour cibler les plus pauvres, les marginaux, celles et ceux pour qui la rue est le seul lieu de socialisation possible. Cette surveillance généralisée de l’espace public, correspond en réalité à une chasse aux pauvres de la part des pouvoirs publics.

Les caméras de vidéosurveillance ne permettent pas de faire baisser les infractions, ni même de résoudre des enquêtes, alors enlevez-les !

Quelle est votre stratégie pour lutter contre ces technologies dont l’utilisation reste encore balbutiante et circonscrite ?

Effectivement, c’est très compliqué. L’opacité du système rend la tâche difficile. Alors si on veut lutter contre la surveillance de masse dans la rue, il faut s’attaquer à la racine, la vidéosurveillance. L’argument des industriels pour convaincre les mairies de déployer la vidéosurveillance algorithmique, c’est de dire : « Vous avez tellement installé de caméras qui ne servent à rien, autant y ajouter de l’intelligence artificielle pour prédire et détecter les comportements suspects ». Alors nous, notre argument c’est de dire, toutes les études l’ont prouvées (celles de la gendarmerie, de la Cour des comptes), les caméras de vidéosurveillance ne permettent pas de faire baisser les infractions, ni même de résoudre des enquêtes, alors enlevez-les !

Les Jeux olympiques 2024 vont servir à tester la population vis-à-vis de ces technologies.

La lutte contre l’insécurité, la criminalité, le terrorisme servent généralement à justifier la généralisation de la surveillance. Pourquoi et comment expliquer un tel déploiement si la vidéosurveillance est à ce point inefficace ?

C’est une vraie question ! Pourquoi les maires achètent-ils des caméras alors qu’ils savent que ça ne sert à rien ? Peut-être parce que si les délinquants ne voient pas les caméras, les électeurs, en revanche, y sont attentifs. En plus, ça coûte moins cher que de mettre en place des politiques sociales visant à construire des écoles ou des crèches. Ça permet aux maires de donner, à peu de frais, l’impression qu’ils agissent.

Chaque événement festif est l’occasion pour le gouvernement d’habituer les gens à cette surveillance absolue.

Et puis, petit à petit, la présence des caméras dans les rues devient la norme, les gens s’habituent. C’est comme si chaque événement ou moment festif était l’occasion pour le gouvernement d’habituer les gens à cette surveillance absolue. En ce sens, les Jeux olympiques 2024 vont constituer un laboratoire d’expérimentation technique pour mettre en avant l’industrie française aux yeux du monde mais également une expérimentation sociale pour tester comment la population se positionne vis-à-vis de ces technologies. Évidemment, si ton visage est scanné pour aller à un concert ou dans un stade, tu auras moins envie de détruire les portiques que si tu es scanné avant d’arriver en manifestation. C’est un moment de fête, pas un moment pour penser aux violences policières ou à l’autoritarisme de l’État. Et c’est là que ça devient dangereux.

Margaux Dzuilka